本文重點:

- 模型上下文協議 (MCP) 是一種由 Anthropic 開發的開放標準,旨在為 AI 模型與外部數據源和工具建立統一的溝通橋樑,如同 AI 界的 USB。

- MCP 採用客戶端-伺服器架構,標準化 AI 模型與各式外部資源的連接方式,降低整合複雜度,提升互操作性。

- 透過 MCP,AI 應用程式能安全且高效地存取本地及遠端資料,擴展功能,實現更強大的 AI 代理和自動化工作流程。

- MCP 不僅簡化 AI 整合,更促進 AI 生態系統的發展,降低供應商鎖定風險,並推動更小巧、更高效 AI 模型的發展。

- 儘管 MCP 仍處於早期階段,但已獲得 OpenAI、Microsoft 等科技巨頭的支持,展現其成為 AI 互操作性標準的巨大潛力。

你有沒有覺得現在的 AI 模型,很像厲害的學者,但書房裡卻只有書本,沒辦法直接連上網路查資料? 雖然大型語言模型 (LLM) 這幾年超火紅,功能強大,但它們就像一座座孤島,很難跟外部世界即時互動,應用上就受到了限制。為了打破這個僵局,Anthropic 公司推出了模型上下文協議 (MCP)。這個 MCP 就像是幫 AI 模型裝上了 USB-C 連接埠,讓它們能用統一的方式連接各種外部資源。這不只是技術上的進步,更可能像 USB-C 一樣,為整個 AI 生態系統帶來革命性的發展!

什麼是模型上下文協議 (MCP)?AI 界的 USB-C 通用連接埠

模型上下文協議 (Model Context Protocol, MCP),是由 AI 公司 Anthropic 在 2024 年 11 月發布的一個開放標準 1。 簡單來說,MCP 的目標就是要解決現在 AI 模型在連接外部資料和工具時遇到的麻煩,建立一套通用又標準的溝通方式。

想像一下,你家的電腦要連接印表機、滑鼠、隨身碟,如果每個裝置都要用不同的接頭,是不是會很崩潰? MCP 就像是 AI 界的 USB-C,要替 AI 應用程式打造一個通用連接埠。就像 USB-C 統一了各種電子裝置的連接方式,MCP 想要統一 AI 模型和外部世界的資料交換方式,讓它們可以真正地互聯互通。

過去,如果想讓 AI 模型 (像是 ChatGPT 或 Claude) 連接外部資訊,例如即時資料庫或線上 API,就像是要為每種服務量身打造不同的插頭和線路。這樣做不只花時間又費力,之後的維護和相容性也是一大問題。 MCP 的出現,就是要終結這種混亂的局面,提供一個統一的介面,讓 AI 模型可以用標準的方式,跟各種不同的外部資源溝通。

MCP 的價值與優勢:打破數據孤島,釋放 AI 潛能

MCP 就像是幫 AI 模型打通任督二脈,讓它們的能力大爆發!它主要有以下幾個厲害的地方:

- 整合更簡單,開發成本降低: 就像 USB-C 讓電子產品連接變得超簡單,MCP 的標準化協議,讓 AI 開發者不用再為了不同的資料來源和工具,開發客製化的整合方案。

- 提升互操作性,促進生態系統發展: MCP 是一個開放的協議,鼓勵大家都來用,就像大家一起講同一個語言,溝通就更順暢!這樣就能建立一個互聯互通的 AI 生態系統。 在這個生態系統裡,不同的 AI 模型可以更容易地共享和使用各種外部資源,打破資料孤島,讓資源能更有效利用,創造更大價值 2。

- 增強 AI 功能,拓展應用場景: 有了 MCP,AI 模型可以輕鬆連接各種外部資源,像是即時資料庫、API 服務、檔案系統等等,獲取更豐富的背景資訊,就能執行更複雜、更實用的任務。舉例來說,AI 助手可以即時查詢庫存資訊,幫電商客服省下不少時間;或是分析最新的市場數據,協助投資人做決策!

- 降低被供應商綁架的風險,提升靈活性: MCP 是一個agnostic (模型不可知) 的協議,就像 USB-C 不管哪家廠牌的手機都能用。企業可以更自由地選擇不同的 AI 模型供應商,不用擔心換了模型就要重新整合外部資源。 這樣就降低了對單一供應商的依賴,讓企業在 AI 技術應用上更有彈性和自主權。

- 促進更高效 AI 模型的發展: MCP 的出現,也可能讓 AI 發展走向更精巧、更有效率的方向。 未來,企業可能不需要追求打造超大型、什麼都懂的 AI 模型,而是可以利用 MCP,讓小型的模型也能透過即時存取外部資源,獲得所需的資訊和能力。這樣就能降低模型訓練和部署的成本,讓更多人能用得起 AI。

- 提升安全性,保護資料隱私: MCP 協議內建安全機制,像是採用 OAuth 2.0 身份驗證標準,確保 AI 模型在安全可控的環境下存取外部資源,降低資料外洩的風險。 而且,MCP 伺服器可以自行管理資源的存取權限,不用把 API 金鑰等敏感資訊交給 LLM 供應商,安全性更上一層樓。

MCP 的運作原理:客戶端-伺服器架構,標準化訊息傳輸

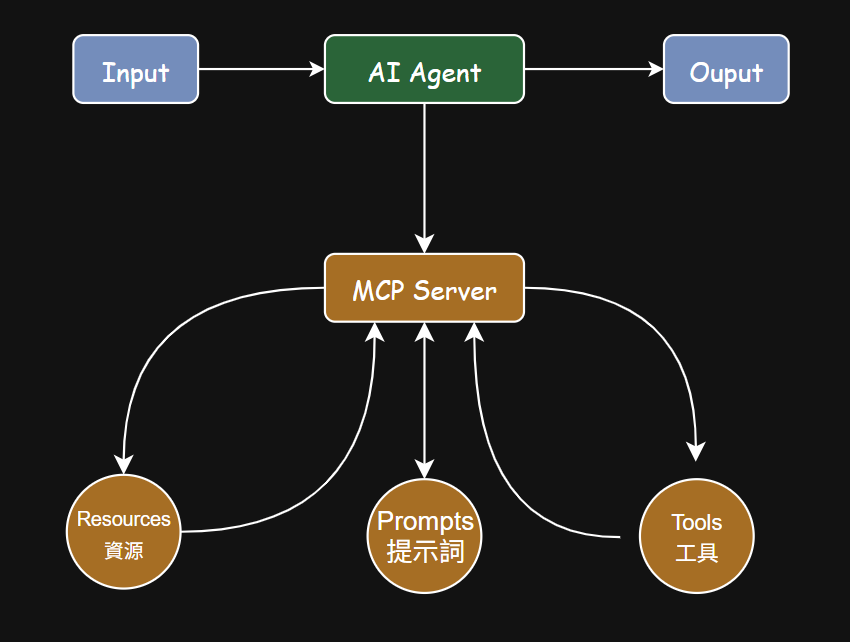

MCP 的運作方式,就像我們平常上網瀏覽網頁一樣,採用 客戶端-伺服器 (Client-Server) 架構 3。

- MCP 客戶端 (MCP Client): 通常是 AI 模型本身,或是使用 AI 模型的應用程式。它就像瀏覽器一樣,負責發出請求,並接收伺服器回傳的結果。

- MCP 伺服器 (MCP Server): 就像網站伺服器一樣,負責提供特定的資源或功能,例如資料庫、搜尋引擎、檔案系統、API 服務等等。伺服器收到客戶端的請求後,會執行相對應的操作,再把結果回傳給客戶端。

簡單來說,運作流程就像這樣:

- AI 模型 (MCP 客戶端) 發出請求: 當 AI 模型需要外部資訊或功能時,會向 MCP 客戶端發出請求。 比如說,當使用者問「今天天氣如何?」時,AI 模型就會知道需要查詢外部天氣資訊。

- MCP 客戶端與 MCP 伺服器溝通: MCP 客戶端會根據請求內容,判斷要連接哪個 MCP 伺服器,這邊你可以串接各式伺服器 (例如:天氣資訊伺服器)。 然後用 JSON-RPC 2.0 這種共通的語言,透過標準輸入輸出 (Standard Input/Output) 或基於伺服器發送事件 (Server-Sent Events, SSE) 的 HTTP 通訊機制,向伺服器發送請求。

- MCP 伺服器處理請求並返回結果: MCP 伺服器收到請求後,會先確認客戶端的身份 (例如:OAuth 2.0),確定它有權限存取。 接著,伺服器會執行請求的操作 (例如:查詢天氣資料庫),並把結果用 JSON-RPC 2.0 格式回傳給 MCP 客戶端。

- AI 模型整合結果並生成回應: MCP 客戶端收到伺服器回傳的結果後,會把資料交給 AI 模型。 AI 模型會把外部資訊整合到它的回答中,最後產生使用者看到的答案,例如:「今天天氣晴朗,氣溫攝氏 25 度。」

MCP 伺服器主要提供三種功能:

- 資源 (Resources): 提供資料存取能力,像是資料庫、檔案系統、網頁內容等等。

- 工具 (Tools): 提供功能調用能力,像是發送郵件、執行程式碼、控制外部設備等等 (類似 Function Calling)。

- 提示 (Prompts): 提供預先設定好的提示或範本,幫助 AI 模型更好地完成特定任務。

MCP 與 Function Calling 的區別:標準協議 vs. 功能機制

你可能會想,MCP 跟現在很流行的 Function Calling (功能調用) 技術有什麼不一樣? 雖然它們的目的都是為了擴展 AI 模型的功能,但本質上還是有差別的:

- MCP 是一種標準協議: MCP 的重點在於建立一個開放的溝通協議,定義 AI 模型和外部資源之間訊息交換的標準格式和流程。 它關注的是如何建立連接、如何溝通,目標是讓不同的系統可以互相操作 4。

- Function Calling 是一種功能機制: Function Calling 比較像是 AI 模型自己內建的一項技能,讓模型可以判斷什麼時候需要呼叫外部函數,並且產生呼叫函數需要的參數。 它關注的是 AI 模型本身的能力,讓模型可以更靈活地與外部世界互動。

簡單來說,Function Calling 是 AI 模型學會了「說外語」的能力,而 MCP 則是建立了一條「國際通道」。 Function Calling 可以搭配 MCP 使用,讓 AI 模型透過 MCP 這個標準化的管道,更有效率地使用外部工具和服務。

MCP 的應用場景:從 AI 助手到自動化工作流程

MCP 的應用範圍非常廣泛,只要是需要 AI 模型與外部世界互動的場景,幾乎都能派上用場,例如:

- AI 助手與聊天機器人: 讓 AI 助手可以存取使用者的行事曆、郵件、雲端硬碟等個人資料,提供更個人化、更實用的協助。 像是 AI 助手可以根據你的行程安排會議、幫你查詢最新的郵件、或是在雲端硬碟裡找檔案,變成你的超級個人助理。事實上,過去也有不少n8n agentic workflow能過做到,但是mcp能夠更輕鬆、快速地完成這件事。

- AI 驅動的 IDE (整合開發環境): 如果把 MCP 整合到 IDE 裡面,讓 AI 模型可以存取程式碼倉庫、開發工具、API 文件等資源,幫助開發者更有效率地寫程式、測試和部署。 像是 AI 可以自動完成程式碼、幫忙debug、或是根據 API 文件自動產生程式碼片段,讓開發效率大大提升。

- 自動化工作流程: 利用 MCP 連接企業內部的各種系統和外部服務,打造自動化工作流程,提升工作效率。 像是自動化客服系統可以透過 MCP 即時查詢訂單狀態、處理退款申請;自動化報表系統可以透過 MCP 從資料庫抓取數據、自動生成分析報告,讓企業流程更順暢。

- AI 代理 (AI Agent): MCP 是打造自主 AI 代理的關鍵基礎。 透過 MCP,AI 代理可以跟各種環境和工具互動,感知環境變化、自己做決策、並執行任務,實現更複雜的自動化任務 5。 像是 AI 代理可以自動監控網路安全威脅、管理智慧城市的交通系統、或是進行科學研究實驗,應用潛力無窮。

如何開始使用 MCP?開發與工具

如果你是開發者,想開始嘗試 MCP,可以從這幾個方向著手:

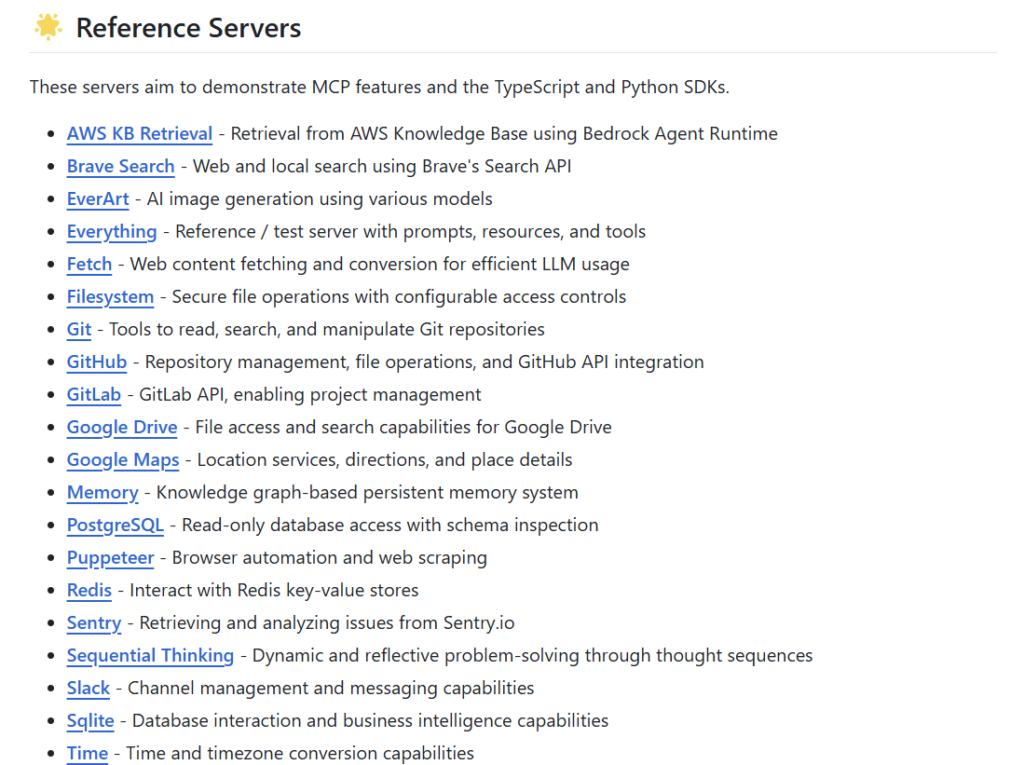

- 開發 MCP 伺服器: 你可以根據自己的需求,開發 MCP 伺服器,提供特定的資源或功能給 AI 模型使用。 Anthropic 提供了多種程式語言的 SDK (軟體開發工具包),讓開發者可以快速建立 MCP 伺服器。 現在已經有一些開源的 MCP 伺服器可以參考,像是可以連接 PostgreSQL、MySQL 資料庫、Git 倉庫、檔案系統等等的伺服器,現在已有陸陸續續的服務加入。

- 開發 MCP 客戶端: 如果你想把 MCP 整合到自己的 AI 應用程式裡,可以開發 MCP 客戶端,讓你的應用程式可以跟 MCP 伺服器溝通。 Anthropic 也有提供 MCP 客戶端的 SDK。

- 使用現有的 MCP 工具: 目前已經有一些工具可以幫助開發者更方便地使用 MCP,像是 Cursor 和 Claude Desktop。 這些工具已經內建了 MCP 客戶端,而且預先設定好了一些常用的 MCP 伺服器連接,讓使用者可以快速體驗 MCP 的功能。 另外,還有 MCP Inspector 等工具,可以幫助開發者debug 和排除 MCP 的問題。

MCP 的未來展望:邁向更開放、更智慧的 AI 生態系統

雖然 MCP 還在發展初期,但它的潛力已經非常驚人。 隨著越來越多科技公司和開發者加入 MCP 生態系統,我們有理由相信,MCP 將在未來的 AI 發展中扮演越來越重要的角色。

MCP 未來的發展方向 可能會包括:

- 更普及的應用: 隨著 MCP 生態系統越來越成熟,預計會有更多 AI 模型、應用程式和服務開始支援 MCP 協議,讓它成為 AI 互操作性的標準。

- 更豐富的功能: 未來 MCP 協議可能會持續擴展,加入更多功能,像是標準化的服務發現機制、更完善的安全機制、以及支援更多種類的資源和工具。

- 更完善的生態系統: 期待看到更多開源的 MCP 伺服器、客戶端工具,以及社群資源出現,一起打造一個更蓬勃發展、更開放、更協作的 MCP 生態系統。

總之,模型上下文協議 (MCP) 的出現,不只是一個新的技術協議,更代表著 AI 開發模式的轉變。 它預示著 AI 技術正從過去的單打獨鬥,走向 互聯互通、合作共榮 的新時代。 就像 USB-C 為電子裝置帶來了統一和便利,MCP 有望為 AI 應用程式帶來更強大的功能、更廣闊的應用場景,以及更蓬勃的發展前景。 讓我們一起期待 MCP 在未來 AI 領域帶來更多驚喜吧!

CoL.ai 觀點

看完這篇文章,你是不是也覺得這個 MCP 有點意思? 我們認為,MCP 真的是替 AI 發展開了一扇窗,讓 AI 模型不再只是活在自己的世界裡,而是能真正地跟外部世界連結。 就像 USB-C 改變了我們使用電子產品的方式,MCP 有機會讓 AI 技術更普及、更實用,應用場景也會更加多元。

雖然 MCP 現在還在發展初期,但已經看到 OpenAI、Microsoft 這些科技巨頭都表示支持,可見大家都很看好它的潛力。 未來,如果 MCP 真的成為 AI 界的通用標準,肯定會加速 AI 技術的創新和應用。

所以,下次聽到人家在講 MCP,別再覺得霧煞煞啦! 記住,它就是 AI 界的 USB-C,一個小小的連接埠,卻可能帶來 AI 發展的大躍進! 你對 MCP 的未來發展有什麼想法呢? 歡迎留言跟我們分享,一起保持對 AI 新技術的好奇心吧!